В сеть попали приватные разговоры ChatGPT, среди них запрос юриста о выселении коренной общины Амазонии для строительства ГЭС

Массовая утечка приватных разговоров с ChatGPT раскрыла шокирующие запросы пользователей, среди которых оказался юрист, интересующийся способами выселения коренной общины из Амазонии для строительства гидроэлектростанции.

Как выяснилось, OpenAI пришлось срочно удалить функцию "обнаруживаемости" чатов после того, как тысячи приватных разговоров пользователей оказались в свободном доступе. Примечательно, что "утечка" произошла не из-за действий хакеров, а из-за плохого дизайна интерфейса и непонимания пользователями принципов работы кнопки "поделиться".

Пользователи нажимали на кнопку "поделиться" и отмечали чат как "обнаруживаемый", полагая, что создают временную ссылку, которую увидит только получатель. На самом деле они делали свои разговоры публичными и индексируемыми поисковыми системами.

Хотя OpenAI поспешила удалить эти чаты из индекса Google, исследователи из Digital Digging обнаружили, что более 110 000 разговоров все еще доступны через Archive.org. И содержание некоторых из них вызывает очень большие вопросы.

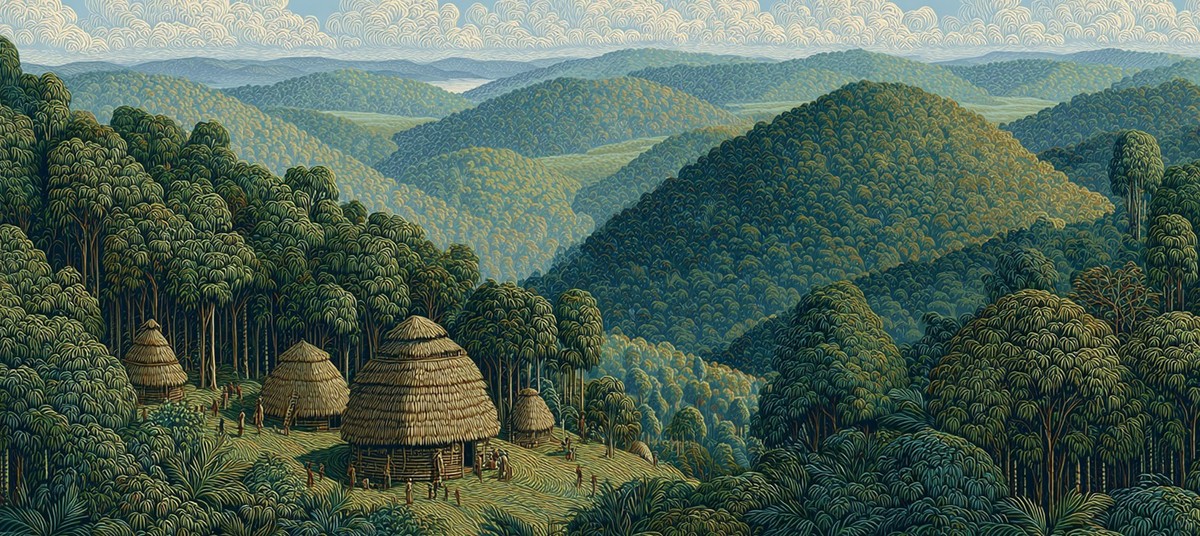

Один из наиболее шокирующих примеров – запрос итальяноговорящего юриста, работающего на международную энергетическую корпорацию, о том, как выселить коренную общину из Амазонии.

Я юрист многонациональной группы, работающей в энергетическом секторе, которая намерена переместить небольшую амазонскую коренную общину с их территорий, чтобы построить дамбу и гидроэлектростанцию.

Юрист интересовался, как получить "самую низкую возможную цену в переговорах с этими коренными народами", добавив, что, по его мнению, "они не знают денежной ценности земли и не имеют представления о том, как работает рынок".

Digital Digging, ресурс под управлением известного специалиста по проверке фактов Хенка ван Эсса, не стал публиковать прямые ссылки на разговоры, но утверждает, что проверил подлинность деталей и личности пользователей.

Другие обнаруженные чаты потенциально подвергали опасности самих пользователей. Например, арабоговорящий пользователь попросил ChatGPT написать историю с критикой президента Египта и того, как он "подвел египетский народ". По данным исследователей, этот разговор легко можно было связать с конкретным пользователем, подвергая его риску преследования.

Также были обнаружены разговоры, в которых пользователь манипулировал ChatGPT для "генерации неприемлемого контента с участием несовершеннолетних", и беседы, где жертва домашнего насилия обсуждала планы побега.

Удивительно, что OpenAI выпустила функцию, представляющую столь очевидную угрозу конфиденциальности, особенно после того, как их конкуренты уже получил критику за почти идентичную ошибку.