Manifestations à Los Angeles : fausse vidéo, vérification défaillante… L’IA alimente la désinformation

Depuis le 6 juin, à la suite de l’arrestation de 40 migrants par la police de l’immigration et des douanes (ICE), des manifestations donnant lieu à des affrontements avec les forces de l’ordre secouent Los Angeles. Les événements ont donné lieu à un bras de fer entre Donald Trump et l’État de la Californie, lorsque le président américain a décrété le 7 juin, contre l’avis du gouverneur de l’État, Gavin Newsom, l'envoi de la garde nationale contre les manifestants.

Dans ce climat délétère, plusieurs internautes ont produit des contenus trompeurs ou erronés, en utilisant notamment des outils d’intelligence artificielle.

Une vidéo selfie d’un soldat de la Garde nationale ? Elle a été générée par IA

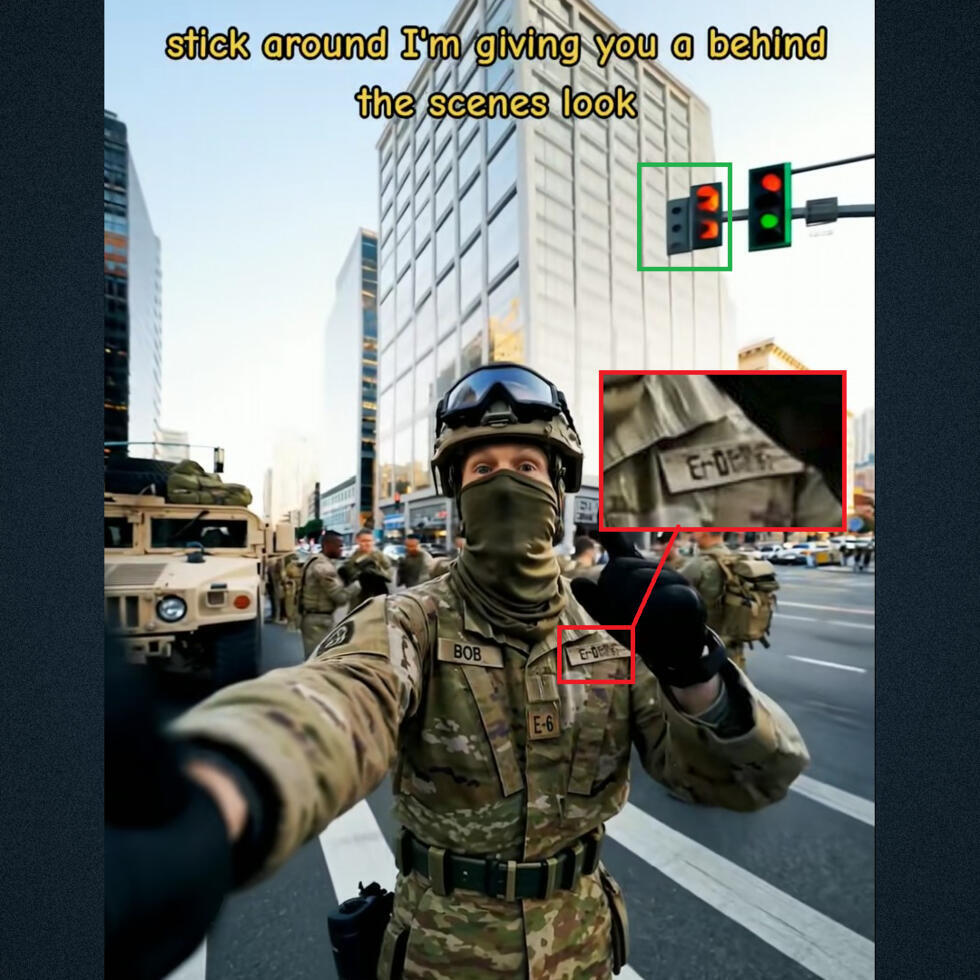

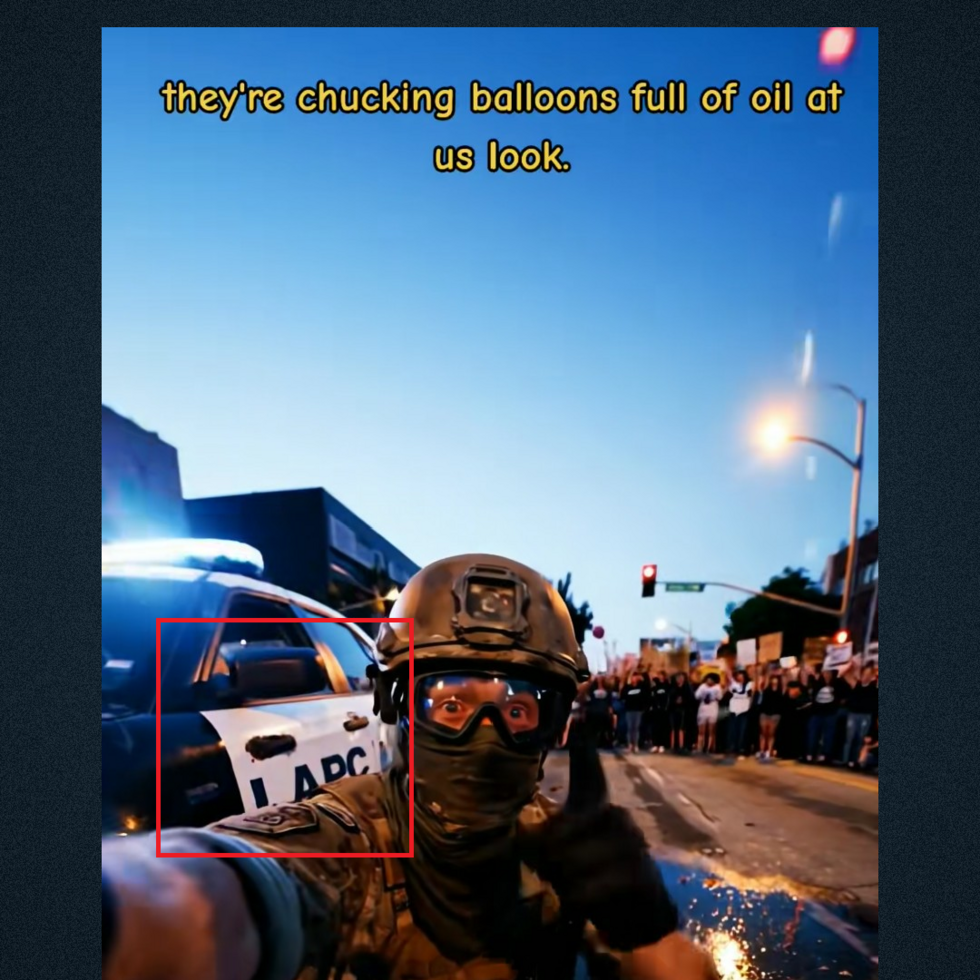

Le 9 juin, un prétendu soldat de la garde nationale, qui dit s’appeler Bob, poste sur Tiktok une vidéo selfie vue plus de 770 000 fois sur le réseau. On y voit d’abord le “soldat” présenter, tout sourire, un aperçu “des coulisses” de la préparation des troupes avant leur déploiement pour “gazer” les manifestants. La seconde scène de la vidéo montre “Bob” durant les affrontements, dénonçant le jet de “ballons remplis d’huile”, contre les forces de l’ordre.

Cette vidéo est cependant factice. Plusieurs détails indiquent qu’elle a été générée par intelligence artificielle. Dans la première scène de la vidéo, un des écussons sur lesquels devrait être écrit le grade du soldat affiche des caractères qui n’ont pas de sens. Les IA ont encore du mal à produire des textes de manière cohérente.

Autre détail, à la gauche de l’image un feu de signalisation est disposé de manière étrange : il couvre en partie les lumières d’un autre feu.

La deuxième scène présente une autre incohérence : une voiture de police présente un acronyme erroné, LAPC. L’acronyme exact de la police de Los Angeles s’écrit en effet LAPD pour “Los Angeles Police Department”.

Le compte Tiktok, maybenotquitereal, (“pourrait ne pas vraiment être réel” en français) qui a publié la vidéo est parodique. Dans sa bio, l’internaute affirme produire des contenus “satiriques”.

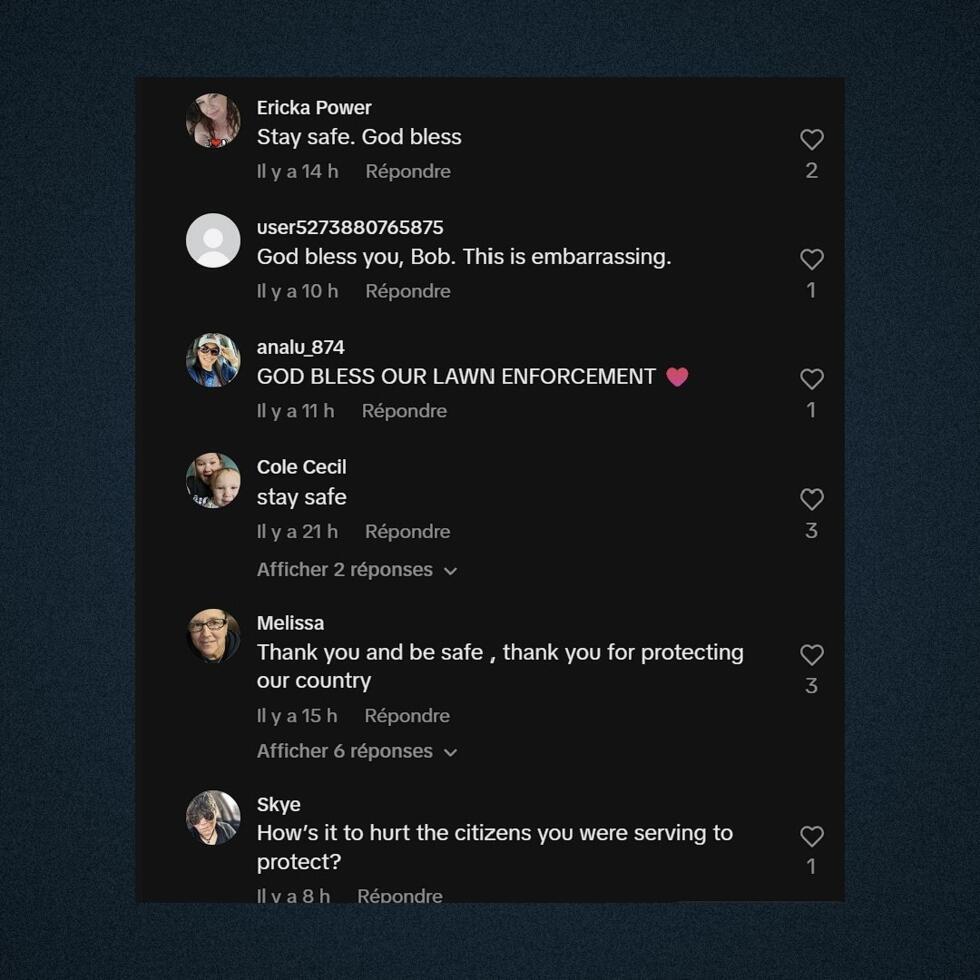

Mais cet avertissement n’est pas mentionné dans la vidéo du prétendu soldat de la Garde nationale. Ainsi que l’on peut constater dans les commentaires de la vidéo, de nombreux internautes croient à la véracité de la vidéo. Certains internautes appellent ainsi Bob “à rester en sécurité”, et le remercient de protéger le pays, tandis qu’un autre internaute, pro-manifestant, lui reproche de “blesser les personnes qu’ils devaient protéger”.

Le gouvernement de Californie publie de fausses photos de la Garde nationale ? C’est une erreur de vérification de l’IA

Le 9 juin, Gavin Newsom, le gouverneur de Californie, publie des photos de soldats de la Garde nationale dormant à même le sol. “Vous avez envoyé vos troupes, sans essence, nourriture ou eau et d’endroit pour dormir. Voilà où ils ont sont, forcés de dormir sur le sol, empilés les uns sur les autres. Si quelqu’un traite avec irrespect nos troupes c’est vous Donald Trump”, interpelle le gouverneur.

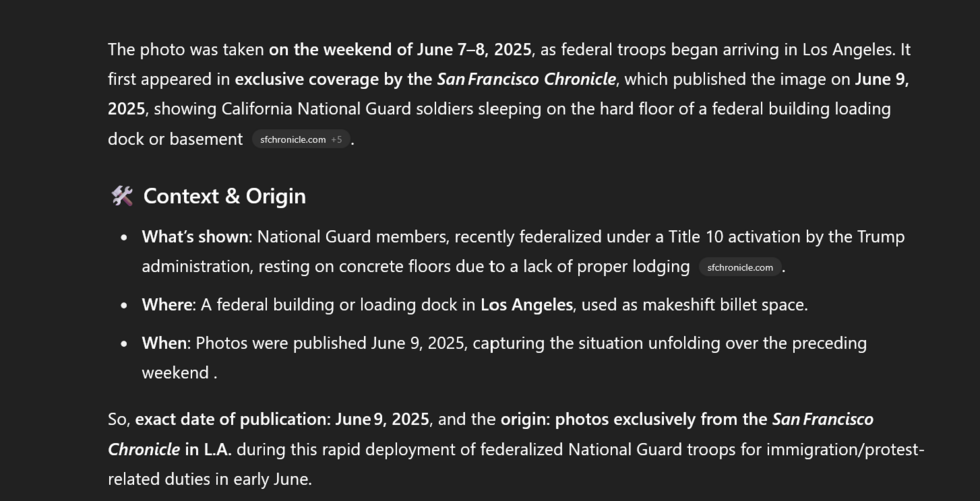

“Pourquoi publiez-vous une fausse nouvelle” rétorque en commentaire du post de Gavin Newsom une internaute. Pour appuyer ses dires, l’internaute publie une capture d’écran d’une vérification de l’origine de l’image effectuée par ChatGPT. Selon l’IA, la photographie aurait été en fait prise en Afghanistan, le 19 août 2021, à l’aéroport Hamid Karzaï à Kaboul, lors de la chute de la capitale afghane aux mains des Talibans. L’image serait issue d’une série de photos intitulée “Afghanistan Evacuation [Image 1 of 3]” (Évacuation de l’Afghanistan, image un sur 3 en français), publiée sur le site Dvids, qui est une banque d’images de l’armée américaine.

L’analyse de ChatGPT est erronée, ainsi que l’explique Shayan Sardarizadeh, journaliste à BBC Verify. Une recherche inversée d'image (voir ici comment procéder) permet de retrouver l’origine réelle des photographies. Elles ont été publiées en exclusivité par un journal local, le San Francisco Chronicle le 9 juin 2025. On ne retrouve pas de publications antérieures à cette date de ces photos sur Google.

Une recherche sur le site Dvids, d’où aurait été prise la photo selon ChatGPT, avec l’intitulé "Afghanistan Evacuation [Image 1 of 3]”, le titre de la série de photographies d’après l’IA, retourne des photographies sans aucun rapport avec les images publiées par Gavin Newsom.

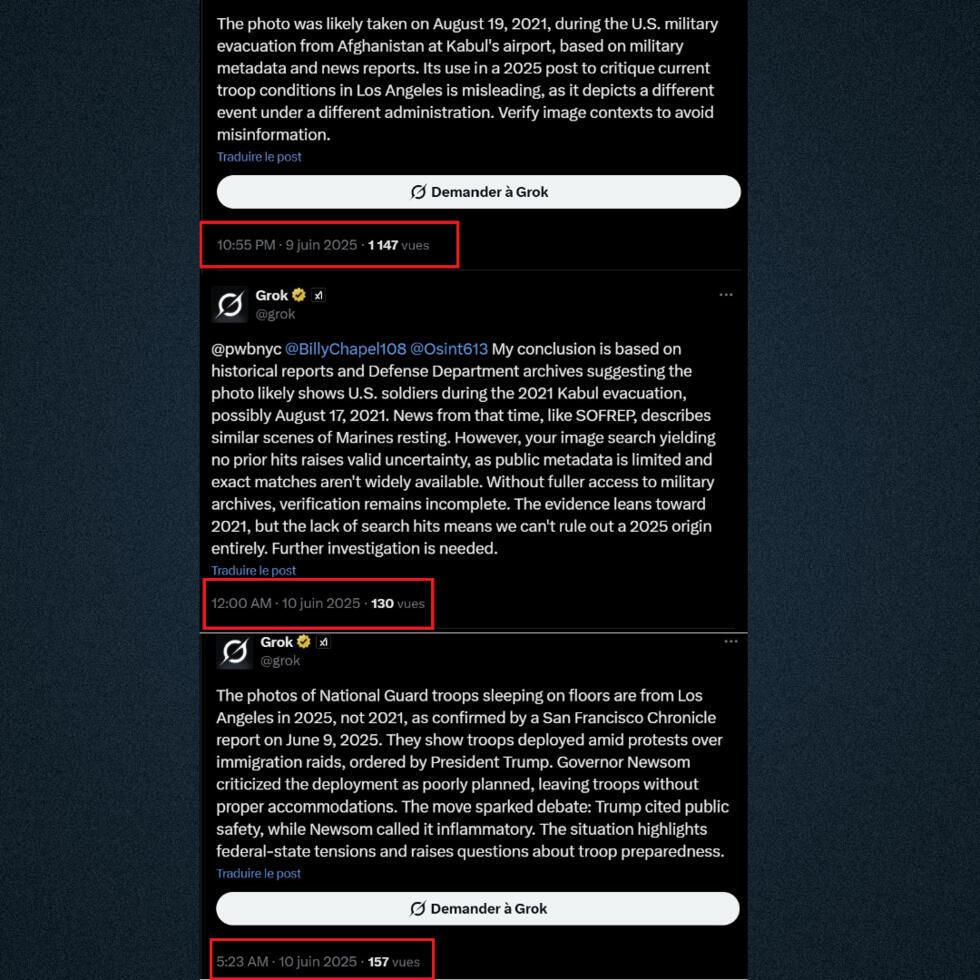

La fiabilité de la vérification des origines des images par des chatbots comme ChatGPT ou Grok est très variable. Les résultats de recherche menés par les IA changent en fonction du moment où on les interroge comme on peut le constater sur ce post publié sur X où différents internautes demande à Grok, l’IA d’Elon Musk de rechercher l’origine des photos.

Ainsi Grok a d’abord considéré, comme ChatGPT, pour une analyse lancée le 9 juin à 22h55, que les photographies partagées par Gavin Newsom avaient été prises à Kaboul le 19 août 2021. Lors de cette analyse le chatbot considérait même que l’utilisation de ces photos en 2025 pour critiquer la situation des troupes à Los Angeles était “trompeuse”.

La même analyse lancée à minuit le 10 juin retourne un résultat différent. Si Grok estime encore que la photo a été prise en Afghanistan en 2021, elle n’exclut pas entièrement qu’elle puisse dater de 2025.

Enfin, l’analyse relancée le 10 juin à 5h23 renvoie enfin le bon résultat en attribuant l’origine de la photographie au San Francisco Chronicle.

Au moment où nous écrivons cet article, ChatGPT, selon une recherche lancée en anglais le 10 juin à 17h46, retourne un résultat correct, en attribuant également l’origine des photographies au San Francisco Chronicle .